坏消息是开源和闭源模型之间的差距越来越大。

好消息,DeepSeek 又来了。

12月1日,DeepSeek发布了两款新型号,—— DeepSeek V3.2和DeepSeek-V3.2-Speciale。

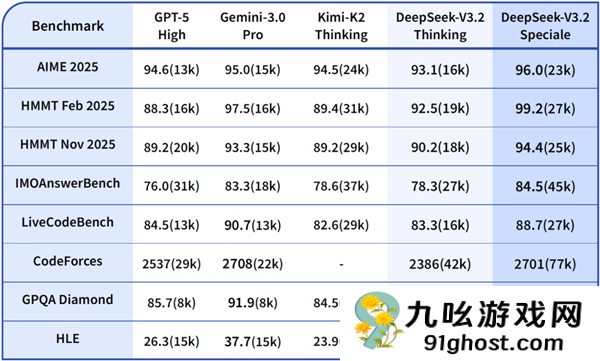

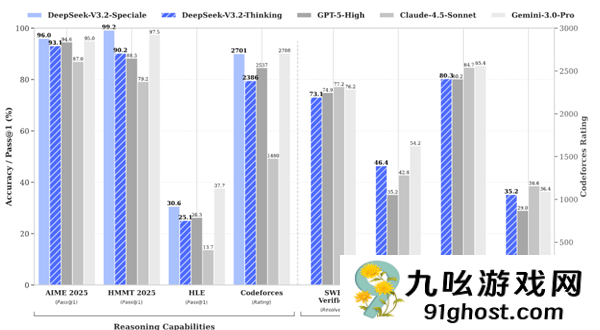

前者和 GPT-5 能打的有来有回,后面的高性能版更是直接把 GPT 爆了,开始和闭源模型天花板 —— Gemini 打了个五五开。还在IMO 2025(国际数学奥林匹克)、CMO 2025(中国数学奥林匹克)等一系列比赛中获得金牌。

这是该公司今年发布的第九款车型,尽管备受期待的R2 尚未上市。

那么,DeepSeek如何利用更小的数据和更少的显卡打造出可以与国际巨头抗衡的模型呢?

我们打开他们的论文,想给大家讲清楚这个事情。

为了实现这一目标,DeepSeek 实现了许多新技巧:

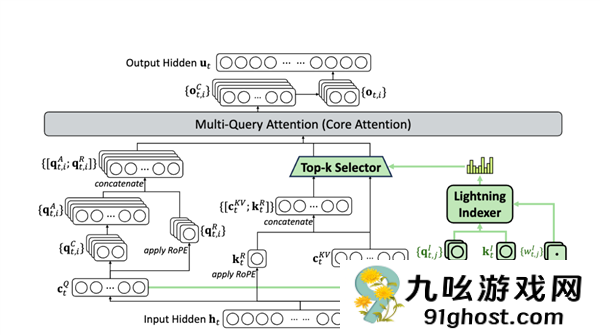

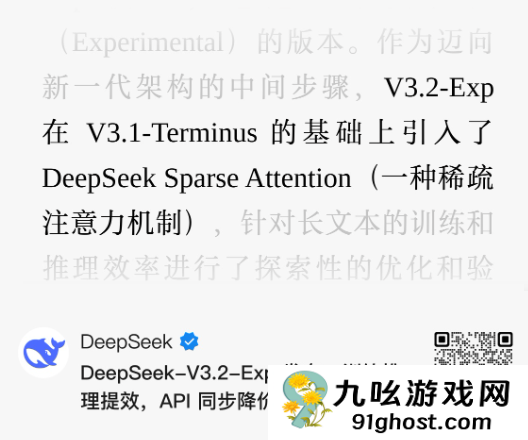

先是把咱们的老朋友 DSA —— 稀疏注意力给转正了。

这个东西在之前的V3.2-EXP版本中就出现过。当时我们只是测试了DSA是否会影响模型的性能。现在我们真的把这个东西放到了主模型上了。

平时和大模特聊天的时候,你会发现越是在对话框里聊天,模特就越容易胡言乱语。

即使他们说得太多,他们也会直接阻止你聊天。

这是大型模型原生注意力机制导致的问题。在这种旧逻辑的影响下,每个令牌必须与之前的每个令牌一起计算。

这导致句子增加了一倍,模型的计算量不得不增加到四倍。如果边长增加三倍,计算量就变成九倍,非常麻烦。

DeepSeek认为这样不行,所以给大模型添加了固定页数的目录(稀疏注意力),相当于帮助模型聚焦。

有了目录之后,以后每次只需要计算这个token和这些目录的关系就可以了。相当于看书时先看目录。读完目录后,你可以确定自己感兴趣的章节,然后仔细阅读本章的内容。

这样,大模型读取长文本的能力就会变得更强。

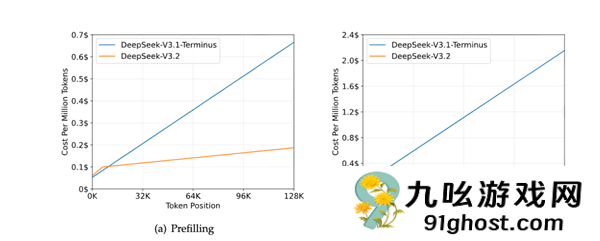

如下图所示,随着句子越来越长,传统V3.1的推理成本越来越高。

但使用稀疏注意力的3.2没有变化。

属于是超级省钱冠军了。另一方面,DeepSeek已经开始关注开源模型的后期训练工作。

大模型从预训练开始到测试评分的过程,其实有点像我们人类从小学开始,一直学习到高考的过程。

之前的大规模预训练,相当于把从小学到高二的所有课本、练习册、试卷都翻了一遍。这一步对于每个人都是一样的。无论是闭源模式还是开源模式,都在老老实实的学习。

但到了高考冲刺阶段就不一样了。在模型的后期训练阶段,闭源模型通常会聘请名师刷题,启动各种强化学习,最终让模型在测试中取得好的成绩。

然而,开源模型在这方面花费的时间较少。 DeepSeek表示,过去的开源模型在训练后阶段的计算投入普遍较低。

这就导致这些模型可能基本能力已经到位,但需要解决的难题太少,导致测试成绩不佳。

因此,DeepSeek这次决定去上名师辅导班,并设计了新的强化学习协议。预训练结束后,它花费了总训练算力的10%以上对模型进行小改进,以弥补缺失的部分。

同时还推出了可以思考很久的特别版本——DeepSeek V3.2 Speciale。

这件事背后的想法是这样的:

过去,大型模型对上下文长度有限制,因此在训练时会做一些标记和惩罚工作。如果模型深入思考的内容太长,就会被扣分。

到了DeepSeek V3.2 Speciale的时候,DeepSeek干脆取消了这个扣分项。反而鼓励模型想思考多久就思考多久,想怎么思考就怎么思考。最终,这款全新的DeepSeek V3.2 Speciale成功与前几天火爆的Gemini 3展开竞争。

此外,DeepSeek还非常重视模型在智能代理方面的能力。

一方面,为了提高模型的基础能力,DeepSeek搭建了虚拟环境,合成了数千条数据来辅助训练。

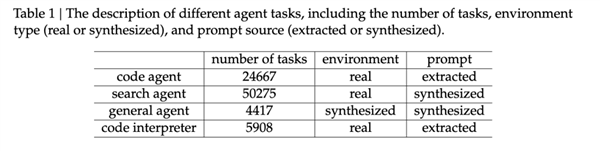

DeepSeek-V3.2使用24667个真实代码环境任务、50275个真实搜索任务、4417个合成通用代理场景和5908个真实代码解释任务进行后训练。

另一方面,DeepSeek也优化了模型使用各种工具的流程。

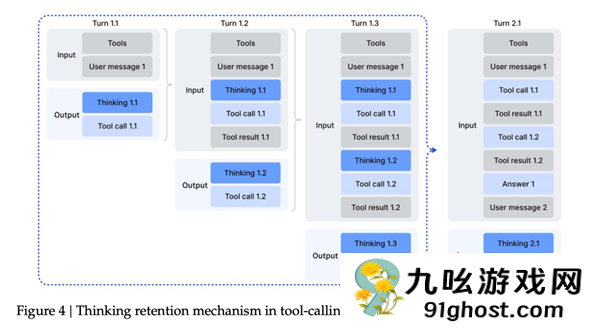

前几代DeepSeek 的一个典型问题是它将思考与使用工具分开。

一旦模型调用了外部工具,前面的思路就基本结束了,工作就完成了。当工具在检查结果后返回时,它通常必须再次列出想法。

这会导致非常愚蠢的体验—— 即使你只是检查像“今天的日期是什么”这样琐碎的事情,模型也会从头开始重建整个推理链,这是一个巨大的时间浪费。

在V3.2中,DeepSeek忍无可忍,直接推翻了这个逻辑,重新做了一遍。

当前规则变为:在一整串工具调用的过程中,模型的“思考过程”会一直保留下来,只有当用户发来一条新的提问时,才会重置这一轮推理;而工具的调用记录和结果,会像聊天记录一样一直留在上下文里。

通过修改模型架构、注重后期训练、强化Agent能力这三个步骤,DeepSeek终于让其新模型再次具备了与世界顶级开源模型竞争的能力。

当然,即使有这么多改进,DeepSeek 的性能也并非完美。

但托尼最喜欢 DeepSeek 的一点,就是他们愿意承认自己的不足。而且还会直接在论文里写出来。例如,本文提到,这次DeepSeek V3.2 Speciale 与Google 的Gemini 3 Pro 50-50 不相上下。

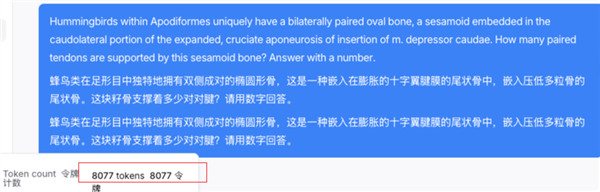

但是要回答相同的问题,DeepSeek 需要花费更多的 token。我自己也测试了一下,从《人类的期末考试》题库中随机选了一道题,同时扔给Gemini 3 Pro和DeepSeek V3.2 Speciale这两款机型。

主题是:

蜂鸟在足形动物中是独一无二的,因为它拥有两侧成对的椭圆形骨,这是一种嵌入扩展的十字腱膜中的尾骨,该腱膜压低了多粒骨。这块籽骨支撑着多少对肌腱?请用数字回答。

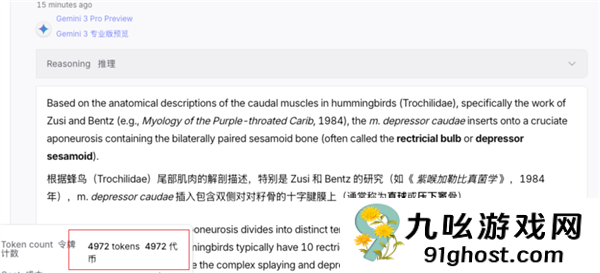

原来Gemini只需要4972个Token就可以回答这个问题。

至于DeepSeek,花了8077个Token才解决这个问题。

仅从使用情况来看,DeepSeek 的Token 消耗几乎高出了60%,这确实是一个很大的差距。

但话又说回来。

DeepSeek虽然消耗大量代币,但价格便宜。

依然问着同样的问题,我又仔细地看了看账单。

DeepSeek 8000 多个 tokens,花了我 0.0032 美元。但是Google这边还不到5000个代币,所以花了我0.06美元?这比DeepSeek 高20 倍。

从这个角度来说,我感觉DeepSeek更好。

最后,让我们回到本文的开头。

正如DeepSeek 所说,开源模型和闭源模型之间的差距在过去六个月里一直在拉大。

但他们依然用自己的方式不断追赶这个差距。

DeepSeek的各种节省计算能力和节省数据的操作实际上让我想起了上个月对Ilya Sutskever的采访。

OpenAI的前灵魂认为,一味地给模型添加参数是没有未来的。

AlexNet 仅使用两个GPU。 Transformer 刚出现时,实验规模大多在8 到64 个GPU 之间。按照今天的标准,这甚至相当于几个GPU 的大小,对于ResNet 来说也是如此。没有哪篇论文靠庞大的集群才能完成。与算力的积累相比,算法的研究同样重要。

这正是 DeepSeek 在做的事情。从V2的MoE,到V3的多头潜在注意力(MLA),再到今天的DeepSeek Math V2的自我验证机制,V3.2的稀疏注意力(DSA)。

DeepSeek 向我们展示了进步,这种进步从来都不是单一的,并且依赖于堆叠参数规模带来的改进。

而是在想办法,如何用有限的数据,来堆积出更多的智能。巧妇狂作无米之炊那么,R2什么时候来呢?